La tecnología de procesamiento de datos ha evolucionado considerablemente en la última década. Dos de las herramientas más populares en este ámbito son Hadoop y Spark. Ambas son plataformas de código abierto que permiten el procesamiento de grandes volúmenes de datos, pero tienen diferencias clave que las hacen adecuadas para diferentes tipos de tareas. En este artículo, exploraremos en profundidad las características, ventajas y desventajas de cada uno, así como sus aplicaciones en el mundo real.

¿Qué es Hadoop?

Hadoop es un marco de trabajo que permite el almacenamiento y procesamiento de grandes conjuntos de datos de manera distribuida. Fue creado por Doug Cutting y Mike Cafarella en 2005 y se basa en el concepto de mapreduce, que divide las tareas en partes más pequeñas que pueden ser procesadas simultáneamente por diferentes nodos en un clúster. Este enfoque permite manejar datos de forma escalable y eficiente, lo que lo hace ideal para empresas que necesitan procesar grandes volúmenes de información.

El ecosistema de Hadoop incluye varios componentes, entre los que se destacan el Hadoop Distributed File System (HDFS) y el YARN (Yet Another Resource Negotiator). HDFS es responsable del almacenamiento de datos, mientras que YARN gestiona los recursos y la programación de tareas en el clúster. Juntos, estos componentes permiten que Hadoop funcione de manera eficaz en entornos de big data.

Diferencia entre char y varchar

Diferencia entre char y varcharCaracterísticas de Hadoop

- Escalabilidad: Hadoop puede escalar fácilmente agregando más nodos al clúster, lo que permite manejar más datos sin comprometer el rendimiento.

- Almacenamiento distribuido: Los datos se distribuyen a través de múltiples nodos, lo que proporciona redundancia y seguridad.

- Coste efectivo: Al ser de código abierto, las empresas pueden utilizar Hadoop sin pagar licencias costosas.

- Capacidad de procesamiento por lotes: Hadoop es ideal para tareas que no requieren resultados en tiempo real.

¿Qué es Spark?

Apache Spark es otro marco de trabajo de procesamiento de datos, pero a diferencia de Hadoop, está diseñado para ofrecer un rendimiento más rápido y una mayor flexibilidad. Lanzado en 2010, Spark utiliza la memoria para procesar datos, lo que le permite realizar tareas en tiempo real y de manera más eficiente. Esto lo convierte en una opción popular para aplicaciones que requieren análisis instantáneo y procesamiento de datos en streaming.

Una de las características más destacadas de Spark es su capacidad para trabajar con diferentes fuentes de datos, incluyendo HDFS, bases de datos NoSQL y sistemas de archivos locales. Esto significa que las empresas pueden integrar Spark en su infraestructura existente sin necesidad de una reestructuración completa.

Características de Spark

- Velocidad: Spark es significativamente más rápido que Hadoop, especialmente en operaciones iterativas y en tiempo real.

- Interactividad: Permite a los usuarios realizar consultas interactivas y obtener resultados inmediatos.

- Soporte para múltiples lenguajes: Spark es compatible con Java, Scala, Python y R, lo que facilita su adopción por parte de diferentes equipos de desarrollo.

- Procesamiento en memoria: Spark almacena datos en memoria, lo que reduce la latencia y mejora el rendimiento general.

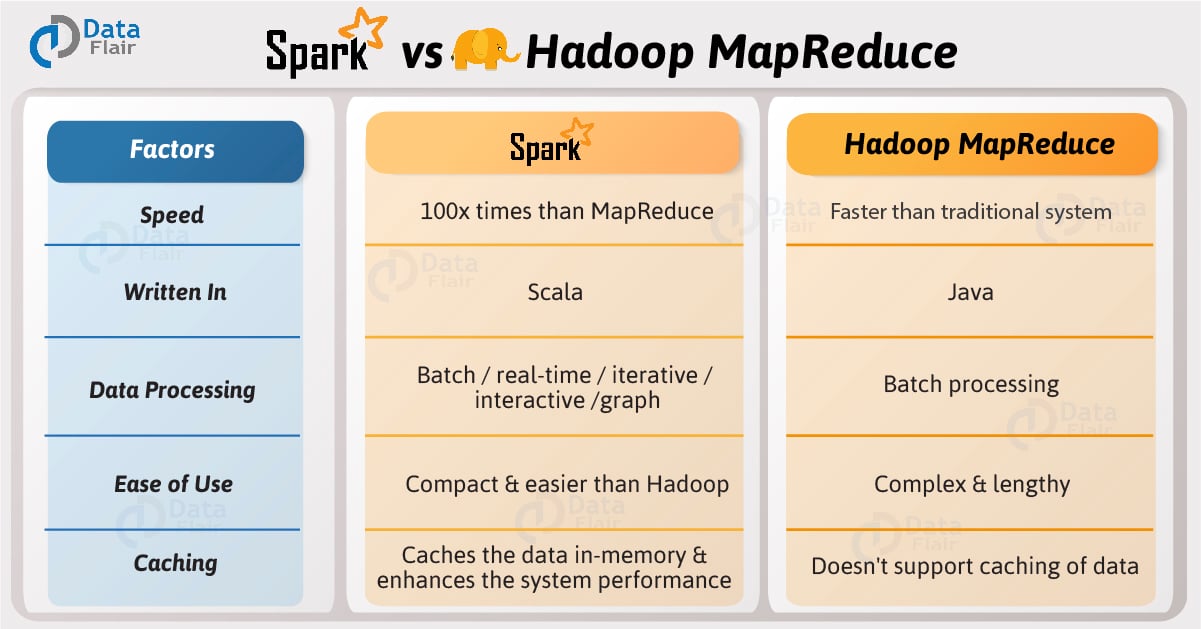

Diferencias clave entre Hadoop y Spark

Aunque tanto Hadoop como Spark se utilizan para el procesamiento de grandes volúmenes de datos, hay diferencias clave que los distinguen. Una de las principales diferencias es la forma en que manejan los datos. Hadoop utiliza un modelo de procesamiento por lotes, mientras que Spark se centra en el procesamiento en memoria y en tiempo real. Esto significa que Spark es más adecuado para aplicaciones que requieren análisis instantáneo, como el análisis de redes sociales o la detección de fraudes.

Diferencia entre el Samsung Exynos 8 octa 8890 y el Exynos 7 octa 7420

Diferencia entre el Samsung Exynos 8 octa 8890 y el Exynos 7 octa 7420Otra diferencia significativa es la complejidad de uso. Hadoop, con su modelo de programación basado en mapreduce, puede ser más difícil de usar para los desarrolladores que no están familiarizados con este enfoque. Por otro lado, Spark ofrece una interfaz más sencilla y APIs más intuitivas, lo que facilita su adopción por parte de equipos de datos y desarrolladores.

Comparación de rendimiento

- Hadoop: Ideal para procesamiento por lotes y tareas de análisis que no requieren resultados inmediatos.

- Spark: Excelente para aplicaciones en tiempo real y procesamiento de datos interactivo.

- Latencia: Spark tiene una latencia mucho más baja en comparación con Hadoop.

Ventajas y desventajas de Hadoop

Hadoop tiene varias ventajas que lo hacen atractivo para las empresas. Su capacidad de escalabilidad es una de las más destacadas, ya que permite a las organizaciones crecer y manejar más datos a medida que sus necesidades aumentan. Además, su arquitectura distribuida garantiza la redundancia y la seguridad de los datos, lo que es fundamental para muchas empresas que manejan información sensible.

Diferencia entre el Samsung Galaxy A3 y el A5 (2016)

Diferencia entre el Samsung Galaxy A3 y el A5 (2016)Sin embargo, Hadoop también tiene desventajas. Su enfoque en el procesamiento por lotes puede ser una limitación para las empresas que necesitan resultados en tiempo real. Además, la curva de aprendizaje puede ser empinada para aquellos que son nuevos en el ecosistema de Hadoop, lo que puede resultar en un tiempo de implementación más largo.

Ventajas de Hadoop

- Escalabilidad: Puede manejar grandes volúmenes de datos de manera eficiente.

- Coste: Es una solución de código abierto, lo que reduce los costos operativos.

- Resiliencia: Ofrece alta disponibilidad y recuperación ante desastres.

Desventajas de Hadoop

- Rendimiento: Puede ser más lento en comparación con otras soluciones, especialmente para tareas en tiempo real.

- Complejidad: La configuración y el uso pueden ser complicados para los nuevos usuarios.

Ventajas y desventajas de Spark

Las ventajas de Spark son significativas, especialmente en términos de rendimiento. Su capacidad para procesar datos en memoria permite una velocidad superior en comparación con Hadoop, lo que es ideal para aplicaciones que requieren análisis en tiempo real. Además, su soporte para múltiples lenguajes de programación hace que sea accesible para una variedad de equipos de desarrollo.

No obstante, Spark también tiene sus desventajas. Aunque es más rápido, puede requerir más recursos de hardware, especialmente memoria, lo que puede resultar costoso. Además, si bien su curva de aprendizaje es menos pronunciada que la de Hadoop, todavía puede ser un desafío para los nuevos usuarios que no están familiarizados con el procesamiento de datos.

Ventajas de Spark

- Velocidad: Proporciona un procesamiento más rápido gracias a su enfoque en la memoria.

- Interactividad: Permite consultas en tiempo real y análisis instantáneo.

- Flexibilidad: Puede integrarse fácilmente con diferentes fuentes de datos.

Desventajas de Spark

- Costos de hardware: Puede requerir más recursos, lo que puede aumentar los costos operativos.

- Consumo de memoria: El uso intensivo de memoria puede ser un problema en clústeres con recursos limitados.

Aplicaciones de Hadoop y Spark

Tanto Hadoop como Spark tienen aplicaciones en una variedad de industrias. Hadoop es ideal para el almacenamiento y procesamiento de grandes volúmenes de datos, lo que lo hace adecuado para análisis de datos históricos, informes de negocios y almacenamiento de datos en la nube. Muchas empresas utilizan Hadoop para almacenar datos no estructurados, como registros de servidores, correos electrónicos y archivos multimedia.

Por otro lado, Spark es más adecuado para aplicaciones que requieren procesamiento en tiempo real, como el análisis de flujos de datos, la detección de fraudes y la personalización de contenido en línea. Las empresas que necesitan obtener información instantánea de sus datos, como las plataformas de redes sociales o las aplicaciones de comercio electrónico, suelen optar por Spark.

Ejemplos de uso de Hadoop

- Almacenamiento de datos: Muchas empresas utilizan Hadoop para almacenar grandes cantidades de datos no estructurados.

- Análisis de datos históricos: Hadoop es ideal para analizar datos de ventas pasados y tendencias del mercado.

Ejemplos de uso de Spark

- Detección de fraudes: Las instituciones financieras utilizan Spark para identificar patrones sospechosos en tiempo real.

- Recomendaciones personalizadas: Las plataformas de comercio electrónico utilizan Spark para ofrecer recomendaciones instantáneas a los usuarios.

Integración de Hadoop y Spark

A pesar de sus diferencias, Hadoop y Spark no son mutuamente excluyentes. De hecho, muchas organizaciones utilizan ambos en conjunto para aprovechar las fortalezas de cada uno. Hadoop puede servir como el sistema de almacenamiento de datos subyacente, mientras que Spark puede utilizarse para realizar análisis rápidos y procesamiento de datos en tiempo real.

La integración de Hadoop y Spark permite a las empresas beneficiarse de un ecosistema de big data más completo. Por ejemplo, los datos pueden almacenarse en HDFS y luego ser procesados por Spark para obtener información valiosa. Esta combinación ofrece una solución robusta y escalable para las necesidades de procesamiento de datos de las empresas modernas.

Casos de uso de integración

- Analítica avanzada: Utilizar Spark para realizar análisis complejos sobre datos almacenados en Hadoop.

- Machine Learning: Aplicar algoritmos de aprendizaje automático en conjuntos de datos grandes almacenados en HDFS.

Conclusiones sobre Hadoop y Spark

En resumen, tanto Hadoop como Spark son herramientas poderosas para el procesamiento de datos, pero tienen diferentes enfoques y aplicaciones. La elección entre uno u otro dependerá de las necesidades específicas de cada empresa, así como de los requisitos de rendimiento y tipo de datos que manejen. Mientras que Hadoop es ideal para el procesamiento por lotes y el almacenamiento de datos, Spark brilla en situaciones que requieren análisis en tiempo real y procesamiento interactivo.

Las organizaciones que comprenden las diferencias y similitudes entre Hadoop y Spark pueden tomar decisiones más informadas sobre cómo implementar estas tecnologías en su infraestructura de datos. Ya sea que elijan uno, el otro o una combinación de ambos, el objetivo final es aprovechar al máximo sus datos para obtener información valiosa y tomar decisiones basadas en datos.